Amazon ha negato il suo riconoscimento facciale alla polizia per un anno

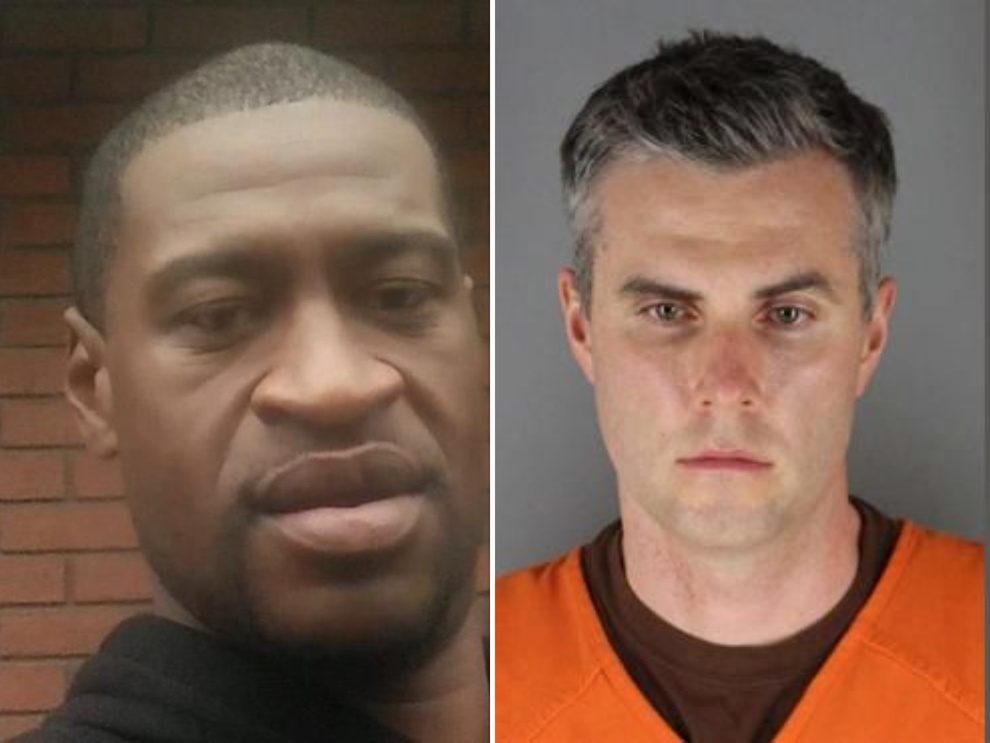

Per un anno le forze dell'ordine statunitensi dovranno fare a meno del servizio di Rekognition, il software per il riconoscimento facciale automatico che Amazon aveva finora messo loro a disposizione. Lo ha deciso il gruppo in queste ore, in seguito alle proteste che si stanno susseguendo in tutti gli Stati Uniti dopo l'uccisione dell'afroamericano George Floyd da parte della polizia di Minneapolis. Per l'azienda le leggi che regolamentano l'uso di questi strumenti non sono ancora sufficientemente rigorose; la speranza è che a un anno a partire da oggi la situazione in questo senso sia cambiata.

IBM: "Diritti umani a rischio"

Amazon non è la prima azienda hi tech ad aver preso una decisione simile. Appena due giorni fa IBM ha aperto la strada con dichiarazioni molto più esplicite, nelle quali ha spiegato come l'uso scorretto di software di riconoscimento facciale possa mettere a rischio la privacy e i diritti umani dei cittadini. Il timore del resto è condiviso da molti: questi sistemi possono scandagliare non solo i video di sorveglianza, ma anche le comuni riprese video di altri cittadini finite online per documentare le proteste.

Agli algoritmi non importa quale sia la fonte delle immagini: i soggetti al loro interno vengono isolati in cerca di altre corrispondenze online o nei database della polizia che ne rivelino l'identità, rendendo potenzialmente pericoloso anche solo partecipare a una manifestazione di dissenso.

Le limitazioni tecniche

Secondo gli studi di numerosi gruppi di ricercatori, i sistemi di riconoscimento facciale hanno inoltre un punto debole da non sottovalutare: dal momento che sono stati addestrati in maggioranza con immagini di persone di etnia caucasica, sono diventati più efficaci nel distinguere i tratti somatici di questa categoria di popolazione. Cittadini afroamericani, asiatici e di altre etnie rischiano di essere confusi tra loro dando adito a scambi di persona che le proteste di queste settimane hanno dimostrato poter essere fatali.

Una decisione attesa

Amazon in realtà non è entrata nel dettaglio delle motivazioni che l'hanno spinta optare per una moratoria di un anno nelle collaborazioni con le forze dell'ordine USA (anzi ha sempre difeso la precisione dei suoi software), ma i gruppi che osteggiano l'utilizzo delle tecnologie di riconoscimento facciale avanzavano questa richiesta nei suoi confronti da molto tempo. Le proteste non hanno fatto che sottolineare l'incongruenza tra il supporto alle comunità afroamericane manifestato da subito dalla multinazionale il suo contratto per la fornitura di servizi tecnologici che potrebbero contribuire all'oppressione di queste stesse comunità.

Richieste simili sono state inoltrate da tempo — e in particolare in questi giorni — a tutte le multinazionali in campo in questo settore. In una lettera inviata a Microsoft sono stati gli stessi dipendenti a chiedere al gruppo di interrompere la propria collaborazione con le forze dell'ordine; la missiva ha seguito di pochi giorni un intervento del CEO nel quale si diceva disposto ad agire per migliorare le condizioni delle comunità afroamericane nel Paese. Clearview AI, un'azienda che sviluppa un potente strumento finito sotto i riflettori per essere in grado di rubare anche le foto dei social per i suoi scopi, ha invece già anticipato di non voler prendere alcuna posizione al riguardo.

;Resize,width=346;)

;Resize,width=346;)